S’immerger dans un monde où la technologie permet de censurer, chez nos enfants, toute expérience possiblement traumatisante. C’est la proposition faite par Arkangel, l’un des épisodes de la quatrième saison de la série Black Mirror.

Une œuvre de science-fiction qui interroge les neurosciences : épisode #1

Parce qu’elle est traumatisée d’avoir perdu de vue sa fille de trois ans brièvement dans un parc, Marie, mère célibataire surprotectrice, décide de recourir à Arkangel, un système révolutionnaire de surveillance pour enfants. Arkangel, qu’on peut traduire en français par « Archange » (qui veille sur) repose sur l’activation d’une puce électronique insérée dans le cerveau de la jeune Sarah et qui permet de suivre, en temps réel, la vie de l’enfant, grâce à l’utilisation d’une tablette numérique. On peut y lire ses constantes vitales, voir ce qu’elle voit et même filtrer les images, les sons et les émotions que la petite fille perçoit comme un stress important. C’est quand son taux de cortisol – une hormone caractéristique du stress qui est renseigné dans le film par la puce – atteint un niveau trop élevé, que la censure audio-visuelle se déclenche automatiquement, avec pour bénéfice supposé la protection de l’enfant.

La protéger de quoi ? D’une menace animale par exemple. C’est le cas lors du premier jour d’école de Sarah, lorsqu’un chien aboie sur son passage en se jetant brusquement sur la grille qui le sépare de la fillette. Mais pour celle-ci, la scène perçue est différente. A cause de l’implant, l’aboiement est un son saturé et le chien une tâche floutée. De quoi aiguiser la curiosité de Sarah sans entraîner la réaction normale de peur toutefois.

Lorsqu’elle grandit, Sarah reste étrangère à certaines expériences qui constituent la normalité chez ceux de son âge. Sa perception de la réalité s’en trouve faussée. Ce qui pose problème. On le comprend dans une scène où son grand-père est victime d’un arrêt cardiaque et l’appelle à l’aide. Au moment des cris, l’image précise de l’homme, pixellisée par l’implant, disparaît de son champ de vision, laissant Sarah sidérée d’incompréhension et, impuissante.

Flirtant avec notre imaginaire, Arkangel évoque ainsi un monde dystopique où l’hypersurveillance des individus et la prise de contrôle de leurs cerveaux dès le plus jeune âge est monnaie courante. Avec un but, discutable : rassurer les parents en protégeant leurs enfants des émotions douloureuses. Cette discussion mise de côté, l’équipe de Cortex Mag s’est interrogée : de tels implants pourraient-ils vraiment exister ? En outre, quelle réalité du fonctionnement cérébral se cache derrière le filtrage potentiel de nos expériences visuelles ?

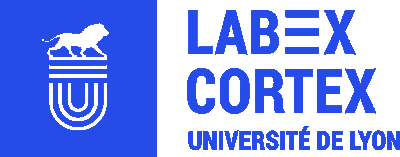

Des interfaces cerveau-machine aident des patients touchés par le syndrome d’enfermement à communiquer

Les implants cérébraux du système Arkangel s’inspirent de la technologie des interfaces cerveau-machine qui existe depuis la fin des années 1990 : période au cours de laquelle un premier patient a été équipé d’un premier implant. Muet et paralysé à la suite d’un accident vasculaire cérébral, le patient avait pu de nouveau communiquer: grâce aux commandes de son cerveau, il était capable de déplacer le curseur d’un écran pour écrire des messages courts tels que « bonjour » et « au revoir »[1]. Les performances atteintes sont modestes, certes. Mais cette avancée a constitué, à l’époque, une véritable prouesse technologique, alors même qu’on la confinait au registre de la science-fiction.

Si les interfaces cerveau-machine sont aujourd’hui connues du grand public, on le doit sans doute avant tout à la médiatisation du projet Neuralink d’Elon Musk. A visée transhumaniste, ce projet ambitionne, ni plus ni moins, de redéfinir les frontières des capacités humaines. Pour le milliardaire, il est question de redonner la vue aux aveugles, d’aider les paralysés à marcher ou encore de guérir des maladies mentales. Au-delà de ce projet médiatique, les interfaces cerveaux machines constituent un sujet d’étude important des laboratoires de neurosciences. Au Centre de recherches en neurosciences de Lyon (CRNL), les scientifiques de l’équipe Cophya les utilisent, entre autres, pour aider les patients touchés par le « syndrome d’enfermement » (en anglais « locked-in syndrome ») à communiquer. Eveillés et conscients, ces patients sont totalement incapables de bouger ou de parler en raison d’une paralysie motrice complète[2]. Mais revenons à Arkangel. Dans l’épisode, la technologie de l’implant permet à la mère de Sarah de voir ce que voit sa fille et de filtrer les informations qu’elle considère dangereuses.

« La mise au point d’un tel dispositif nécessiterait de reconstituer en temps réel les scènes vues par l’enfant à partir des informations émanant de son cerveau et collectées par l’implant. Plus précisément, celles provenant des aires visuelles. C’est un défi énorme », confie Mathilde Bonnefond, co-directrice de l’équipe de recherche Cophy.

Le chemin est encore long avant qu’une IA puisse reconstituer des images complexes comme celles de la vie réelle

Le défi est pluriel. Collecter les informations associées à la perception visuelle tout d’abord. Celle-ci consiste en des traitements de signaux neuronaux successifs impliquant des structures cérébrales distinctes traitant par exemple de la forme, de la couleur, de l’orientation ou du mouvement de la scène vue. L’intégration de toutes ces caractéristiques a donc lieu en réseau[3], un réseau auquel l’implant devrait pouvoir se connecter. Cela fait, après avoir recueilli les informations visuelles judicieuses, il faudrait ensuite concevoir une interface qui puisse reconstruire, en direct, la scène vue par la personne implantée. Or, cette étape nécessiterait des capacités de calculs immenses difficilement envisageables.

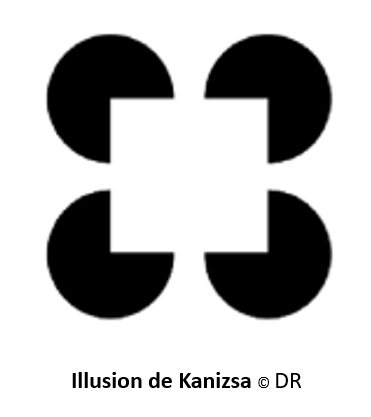

Illustrons ce défi par un exemple : comment reconstituer une forme (et seulement cette caractéristique visuelle) dans une image complexe ? On pourrait utiliser l’intelligence artificielle (IA). Pour cela, il faudrait tout d’abord entrainer l’IA à reconnaître ladite forme, grâce à un nombre important d’images connues, pour qu’ensuite cette celle-ci soit capable de généraliser la reconnaissance de forme dans le cas d’images inconnues. Certains modèles d’IA récents, intégrant le retour d’informations de différentes régions sensorielles, sont capables de réaliser cette tâche. Des chercheurs CNRS de Toulouse ont en effet montré que si l’on entraîne une IA à reconnaître des carrés et qu’on lui présente une illusion de cette forme, à savoir un motif de Kanizsa, alors l’IA reconstitue un carré[4].

Aux dires des spécialistes, ce résultat est remarquable. On conçoit toutefois qu’il reste un long chemin à parcourir pour qu’une intelligence artificielle soit capable de reconstituer des images complexes comme celles de la vie réelle.

Un autre point intéressant d’Arkangel, est la capacité de censure audio-visuelle offerte aux parents grâce au contrôle de l’implant. Selon Mathilde Bonnefond, notre fonctionnement cérébral comporte un principe similaire. Elle explique : « En fonction de l’état dans lequel se situent nos oscillations cérébrales à l’instant où un évènement sensoriel se produit, l’activité cérébrale qui est générée dans nos aires sensorielles a plus ou moins de chance d’être perçu, et d’arriver à notre conscience. C’est ce que l’on appelle le filtrage attentionnel. »

Le filtrage attentionnel repose sur des oscillations cérébrales transitoires

Ce filtrage opéré par notre attention a un rôle protecteur naturel vis-à-vis du cerveau : il lui permet de gagner du temps, et de l’énergie, en éliminant les signaux neuronaux non pertinents. Si, par exemple, on vous donne pour tâche de trouver un individu au pull rouge dans une rue bondée, votre attention se portera préférentiellement sur les indices visuels concordant visuellement, c’est-à-dire de couleur rouge. Les autres stimuli visuels seront plus facilement ignorés car considérés comme non pertinents pour le filtre attentionnel. Selon les théories actuelles, ce sont les oscillations cérébrales de type alphab qui occasionnent le filtrage attentionnel. En effet, il a été proposé que les rythmes alphas sont associés à des pulses d’inhibition, c’est-à-dire à des signaux électriques dont le rôle est d’activer des populations de neurones inhibant un processus cérébral. Ces pulses d’inhibition aideraient les aires sensorielles à ne pas percevoir les stimuli sensoriels lorsqu’ils arrivent en coïncidence avec des moments de forte activité alpha[5].

Un point de discordance, cette fois-ci, important entre le fonctionnement réel de notre cerveau et la technologie vue dans Arkangel : la dimension temporelle associée aux stimuli sensoriels que Sarah doit ignorer, et aux images qu’elles voient comme « floutées ». Le principe même du filtrage attentionnel humain repose sur des oscillations cérébrales qui sont transitoires par essence. Un mécanisme similaire appliqué dans le film devrait donc correspondre à une inhibition elle aussi transitoire vis-à-vis des stimuli extérieurs. Pour reprendre l’exemple du chien aboyant sur Sarah, le floutage visuel subi par la jeune fille devrait apparaitre, puis disparaitre, de façon rythmique, ce qui n’est pas le cas. L’effet rendu à l’écran serait probablement plus angoissant que le fait de ne pas filtrer les stimuli dangereux.

Bien que, sur de nombreux aspects, l’épisode Arkangel soit une fiction loin de la réalité scientifique, il est troublant d’imaginer un monde où les technologies développées aujourd’hui permettent un niveau de surveillance similaire à celui de l’épisode. En nous invitant à examiner de près les dilemmes éthiques et moraux qui accompagnent les avancées scientifiques, Arkangel nous rappelle l’importance de maintenir un équilibre entre sécurité et liberté individuelle dans un monde de plus en plus connecté.

Notes

a/ L’acronyme Cophy signifie : Computation, Cognition et Neurophysiologie

b/ Les oscillations alpha sont lentes. Elles correspondent à des ondes cérébrales de fréquences comprises entre 8 et 12 Hz

Références

[1] Kennedy, P. R., & Bakay, R. A. (1998). Restoration of neural output from a paralyzed patient by a direct brain connection. Neuroreport, 9(8), 1707-1711.

[2] Séguin, P., Maby, E., Fouillen, M., Otman, A., Luauté, J., Giraux, P., Morlet, D & Mattout, J. (2024). The challenge of controlling an auditory BCI in the case of severe motor disability. Journal of NeuroEngineering and Rehabilitation, 21(1), 9.

[3] Gupta, M., Ireland, A. C., & Bordoni, B. (2020). Neuroanatomy, visual pathway.

[4] Pang, Z., O’May, C. B., Choksi, B., & VanRullen, R. (2021). Predictive coding feedback results in perceived illusory contours in a recurrent neural network. Neural Networks, 144, 164-175.

[5] Jensen, O., Bonnefond, M., & VanRullen, R. (2012). An oscillatory mechanism for prioritizing salient unattended stimuli. Trends in cognitive sciences, 16(4), 200-206.